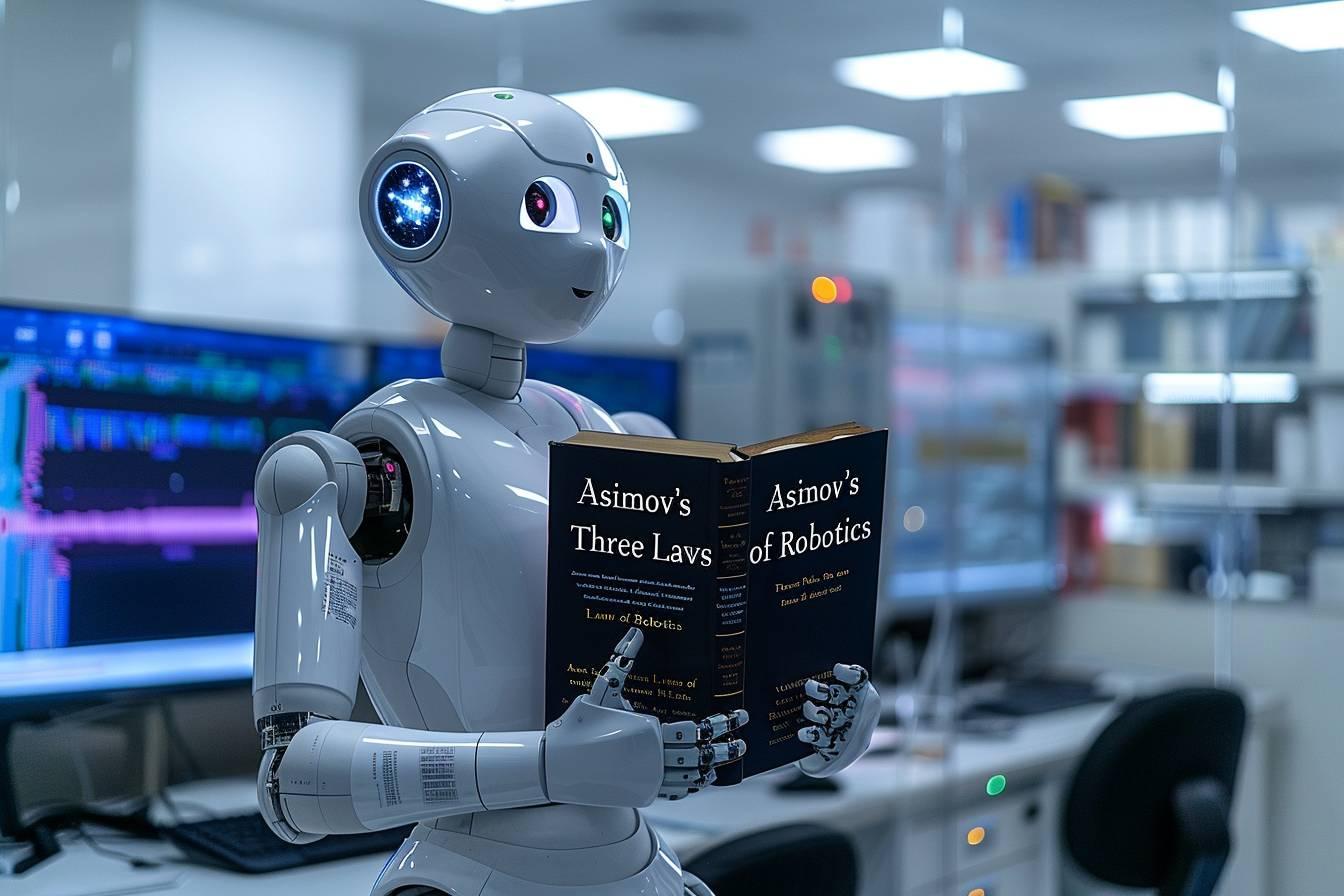

Les 3 lois de la robotique d’Asimov

Sommaire

Les trois lois de la robotique, imaginées par Isaac Asimov, constituent un pilier fondamental dans le domaine de l’intelligence artificielle et de la robotique. Formulées pour la première fois en 1942 dans la nouvelle « Cercle vicieux », ces règles visent à encadrer le comportement des robots et à apaiser les craintes des humains envers les machines. Leur impact perdure encore aujourd’hui, influençant non seulement la littérature de science-fiction, mais aussi les réflexions éthiques et juridiques sur l’IA.

Origine et évolution des lois de la robotique

L’histoire des lois de la robotique commence en 1942, lorsqu’Isaac Asimov les formule pour la première fois dans sa nouvelle « Cercle vicieux ». Ces lois, au nombre de trois initialement, ont été conçues comme un cadre éthique pour guider le comportement des robots dans leurs interactions avec les humains. Elles sont hiérarchisées, avec la Première Loi primant sur la Deuxième, qui prime elle-même sur la Troisième.

Voici les trois lois originales :

- Première Loi : Un robot ne peut porter atteinte à un être humain ni, restant passif, permettre qu’un être humain soit exposé au danger.

- Deuxième Loi : Un robot doit obéir aux ordres donnés par les êtres humains, sauf si ces ordres entrent en conflit avec la Première Loi.

- Troisième Loi : Un robot doit protéger son existence tant que cette protection n’entre pas en conflit avec la Première ou la Deuxième Loi.

Plus tard, Asimov a ajouté une Loi Zéro, qui stipule qu’un robot ne peut pas porter atteinte à l’humanité, ni, par son inaction, permettre que l’humanité soit exposée au danger. Cette addition élargit la portée des lois, passant de la protection individuelle à celle de l’humanité dans son ensemble.

En tant que passionnée d’intelligence artificielle, je trouve passionnant de voir comment ces lois, initialement conçues pour la fiction, ont pris une dimension bien réelle dans nos discussions actuelles sur l’éthique de l’IA. Elles servent de base à de nombreuses intrigues dans les œuvres d’Asimov, mais leur influence s’étend bien au-delà de la littérature.

Impact des lois de la robotique sur l’éthique et la régulation de l’IA

L’influence des lois d’Asimov sur le développement de l’intelligence artificielle et la robotique est indéniable. Elles ont servi de point de départ pour de nombreuses réflexions éthiques et juridiques sur la responsabilité, l’obéissance et l’autonomie des robots. En 2017, le Parlement européen a même fait référence à ces lois dans une résolution sur l’intelligence artificielle et la robotique, soulignant leur pertinence continue dans le débat actuel.

Certains experts considèrent ces lois comme un modèle potentiel pour réguler l’intelligence artificielle. Elles offrent un cadre simple mais puissant pour aborder des questions complexes telles que :

- La sécurité des humains face aux systèmes autonomes

- Les limites de l’obéissance des machines

- L’équilibre entre l’auto-préservation des systèmes et leur devoir envers les humains

Néanmoins, d’autres remettent en question leur applicabilité dans le monde réel, notamment face aux développements récents en robotique militaire. La complexité des situations réelles et les dangers potentiels des robots menteurs posent des défis qui vont au-delà de ces trois lois simples.

Des conférences et débats sont régulièrement organisés pour discuter de la pertinence de ces lois dans le contexte juridique actuel. Ces discussions soulèvent des questions cruciales sur la manière dont nous pouvons intégrer ces principes éthiques dans le développement et la régulation des technologies d’IA.

Défis et limites des lois de la robotique

Bien que les lois d’Asimov aient fourni un cadre de réflexion précieux, leur application pratique soulève de nombreux défis. L’un des principaux problèmes est l’interprétation de ces lois dans des situations complexes du monde réel. Par exemple, comment un robot pourrait-il déterminer ce qui constitue un « danger » pour un être humain dans toutes les situations possibles ?

De plus, l’évolution rapide de l’intelligence artificielle pose de nouvelles questions que les lois d’Asimov n’avaient pas anticipées. Voici un tableau résumant quelques-uns de ces défis :

| Défi | Description |

|---|---|

| Interprétation ambiguë | Les termes « danger » ou « atteinte » peuvent être interprétés différemment selon le contexte |

| Conflits entre les lois | Des situations complexes peuvent créer des conflits entre les différentes lois |

| Éthique de l’IA avancée | Les IA superintelligentes pourraient dépasser le cadre simple des trois lois |

| Autonomie et libre arbitre | Question de l’applicabilité des lois à des IA vraiment autonomes |

Ces défis soulignent la nécessité d’une réflexion continue sur l’éthique de l’IA. Nous devons nous demander si avoir de la compassion pour les robots pourrait influencer notre approche de ces lois et de l’éthique en général dans le domaine de l’IA.

Comme rédactrice passionnée par l’IA, je suis convaincue que l’héritage d’Asimov continuera à jouer un rôle crucial dans notre compréhension et notre approche de l’éthique de l’intelligence artificielle. Les trois lois de la robotique, bien qu’imparfaites, nous offrent un point de départ précieux pour naviguer dans les eaux complexes de l’interaction homme-machine dans un avenir où l’IA jouera un rôle de plus en plus important dans nos vies.

Simone, rédactrice principale du blog, est une passionnée de l’intelligence artificielle. Originaire de la Silicon Valley, elle est dévouée à partager sa passion pour l’IA à travers ses articles. Sa conviction en l’innovation et son optimisme sur l’impact positif de l’IA l’animent dans sa mission de sensibilisation.